「Codex App Serverがなんかすごいらしい」。

そう聞いて気になったので、公式情報や解説動画を見ながら、自分なりに整理してみました。

最初に正直に言ってしまうと、これは私のような非エンジニアが今すぐ直接使える「新しいチャットアプリ」ではありません。ChatGPTのようにブラウザで開いて、すぐ会話できるものではないんですよね。

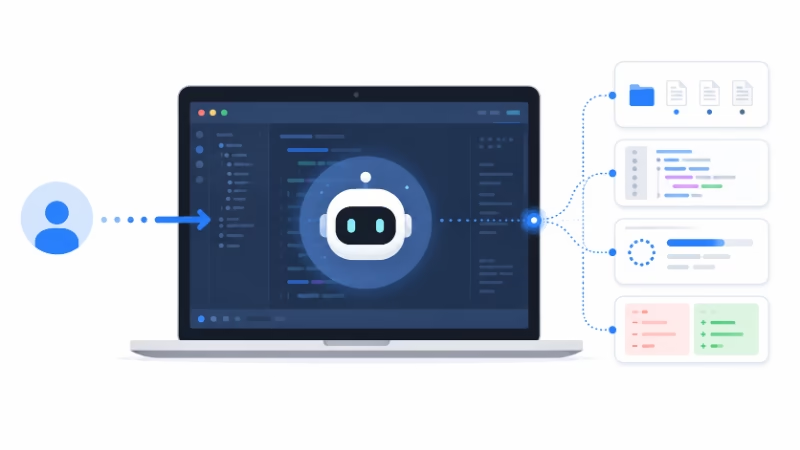

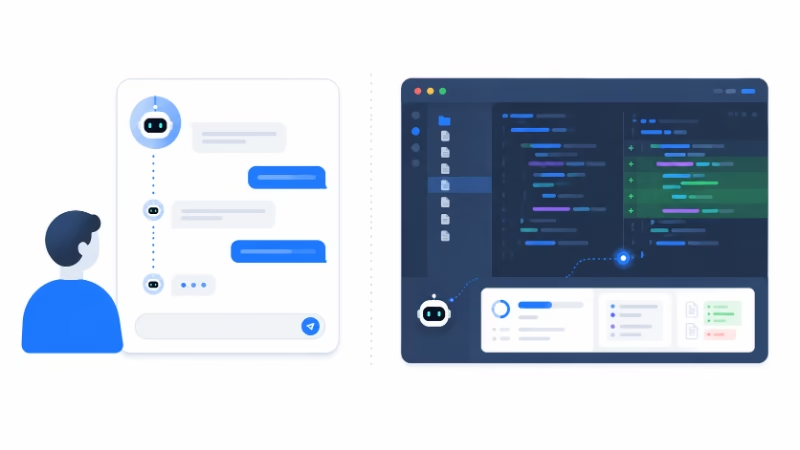

一言でいうと、Codex App Serverは、外部アプリがCodexに仕事を頼むための「窓口」であり、その作業状態をアプリ側で見えるようにする「仲介役」です。

もう少し正確に言えば、Codexの実行基盤である「Codex harness」を、IDEやデスクトップアプリなどの外部アプリから扱えるようにするための仕組みです。

OpenAI公式記事では、CodexはWebアプリ、CLI、IDE拡張、macOSアプリなど複数の場所で使われており、内部では同じCodex harnessが動いていると説明されています。そのCodex harnessと各クライアントをつなぐ重要な接続口がCodex App Serverです。

重要なのは、AIが急に賢くなるわけではないということ。

すごいのは、AIを「単なるチャット相手」ではなく、「アプリの中で状態を持ちながら作業する担当者」として扱いやすくなる点にあります。

まず結論から

Codex App Serverについて、最初に押さえるべき点は3つです。

- 一般ユーザー向けの単体アプリではない

- Codex harnessを、IDEやデスクトップアプリなどから扱うための仕組み

- 進行状況、変更差分、承認リクエストなどをアプリ側の画面に載せやすくするのが大きな価値

つまり、Codex App Serverは「AIに質問するための場所」ではなく、AIの作業を別のアプリに組み込むための部品です。

この前提を最初に置いておくと、話がずいぶん分かりやすくなります。

誤解しやすいポイント

名前だけ見るとかなり分かりにくいので、誤解されやすい点を整理しておきます。

| 誤解 | 実際 |

|---|---|

| ChatGPTの新しいアプリ | そうではなく、外部アプリからCodexを扱うための仕組み |

| 新しいAIモデル | モデルそのものではなく、Codex harnessを使うための窓口 |

| Web上に公開するサーバー | 基本的にはローカルアプリやIDEの裏側で動くプロセスに近い |

| 非エンジニアが直接使うツール | 主にツール・アプリ開発者向けの仕組み |

| AIに何でも自動実行させる仕組み | むしろ承認や差分確認を前提に組み込みやすい仕組み |

| 自分のCodex認証で作ったアプリを他人にそのまま使わせられる | アプリやソースコードの共有と、自分の認証情報を他人に使わせることは別 |

特に大事なのは、Codex App Serverが「完成されたアプリ」ではなく、「アプリにCodexを組み込むための土台」だという点です。

ここを間違えると、「で、どこからログインして使うの?」と迷子になってしまいます。

用語の違いをざっくり整理

この話が分かりにくいのは、似たような言葉がいくつも出てくるからです。

| 用語 | ざっくりした意味 |

|---|---|

| Codex | コードを書いたり修正したりするAIエージェント体験・機能群 |

| Codex harness | Codexが実際に作業するための実行基盤 |

| Codex App Server | Codex harnessを外部アプリから使いやすくする仲介役 |

ユーザーから見ると、CodexはコードのAIです。OpenAI Helpでも、Codexはコードの作成、レビュー、出荷を助けるAIエージェントだと説明されています。

ただし、AIが実際に「作業」するには、単に文章を生成するだけでは足りません。

ファイルを読み、変更案を作り、必要に応じてコマンドを実行し、実行していいか人間に確認し、最終的な差分を出す。

こうした一連の作業を支える土台がCodex harnessです。

そして、その作業状況を外部アプリに渡しやすくするための仕組みがCodex App Serverです。

「Server」という言葉に引っ張られない

「サーバー」と聞くと、Web上に公開された大きなコンピュータを想像しがちですよね。でも、Codex App Serverを理解するときは、まずそのイメージから離れた方がいいです。

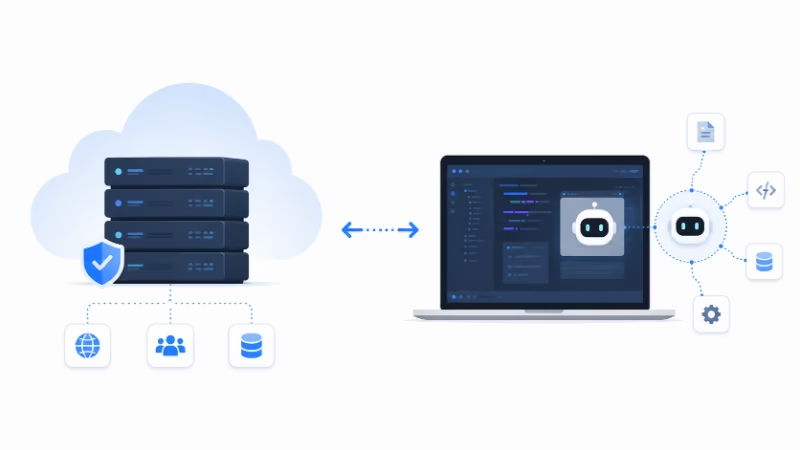

OpenAI公式記事では、ローカルアプリやIDEがApp Serverを長時間動く子プロセスとして起動し、JSON-RPC over stdioで通信する設計だと説明されています。

「JSON-RPC over stdio」は非エンジニアにはほぼ意味不明ですが、かんたんに言うと、アプリの裏側で、アプリとCodexが命令や結果をやり取りするための通路です。

流れはこんなイメージです。

- ユーザーがアプリ上でAIに作業を頼む

- アプリがCodex App Serverという通路に依頼を渡す

- 通路の奥のCodex harnessでAIが作業する

- 進行状況や差分が通路を通ってアプリに返ってくる

- 必要に応じて人間に承認を求める

ただし、ローカルで動くからといって、AIモデルの処理がすべて手元のPCで完結するという意味ではありません。

認証、モデル利用、通信、利用制限などは別途関わってきます。ここは混同しないようにしましょう。

実際には何が起きるのか?

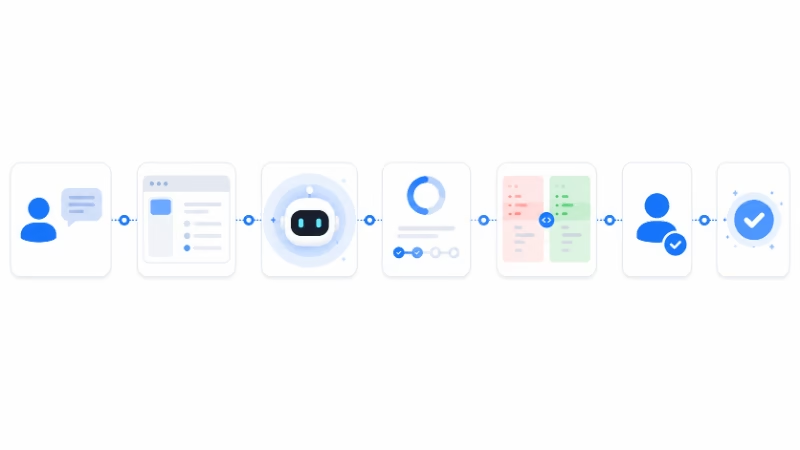

Codex App Serverを使ったアプリでの流れを書き出してみます。

- ユーザーがIDEやデスクトップアプリで「この機能を修正して」と依頼する

- アプリがCodex App Serverにタスクを渡す

- Codex harnessがファイルを読み、必要な作業を判断する

- 途中経過がイベントとしてアプリに返ってくる

- ファイル変更やコマンド実行が必要な場合、アプリ側で承認を求める

- ユーザーが確認し、許可または拒否する

- 最終的な変更差分や結果がアプリに表示される

ここで重要なのは、AIの作業が「一問一答」で終わらないことです。

Codexは状態を持ちながら作業を進め、アプリはその状態を画面に表示できます。人間は途中で確認したり、止めたりできる。

OpenAI公式記事では、App Serverの会話はItem、Turn、Threadという単位で表現されると説明されています。Itemはメッセージやツール実行、承認リクエスト、diffなどの最小単位、Turnは1回のユーザー入力から始まる作業単位、Threadは継続的なCodexセッションです。

「作業プロセスとして扱える」。

これが通常のチャット体験との大きな違いです。

何がそんなにすごいのか?

すごさの核は、「AIをアプリから呼べること」自体ではありません。

本当に大きいのは、AIエージェントを実務の画面に組み込むために必要な要素を、外部アプリ側で扱いやすくする土台が用意されている点です。

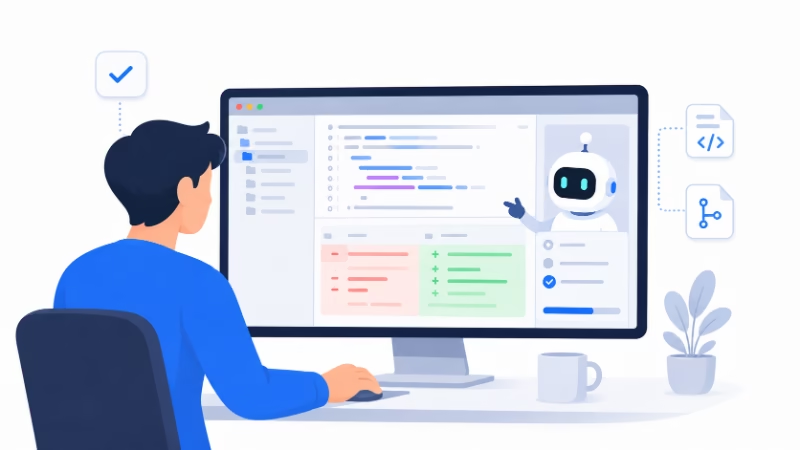

1. 「別タブの相談相手」から「作業画面の担当者」へ

従来のAI活用では、作業場所とAIの場所が分かれていることがほとんどでした。

コードを書くのはVS Code、相談するのはChatGPT。

この形でも十分便利ですが、作業のたびにコピーして、貼り付けて、確認して、また戻す手間が発生します。

Codex App Serverのような仕組みがあると、作業画面の中からAIに依頼できる体験を作りやすくなります。

IDEの中でCodexがコードを読み、修正案を差分として表示する。ユーザーはその場で確認し、必要なものだけ反映する。

AIが「別タブの相談相手」から「作業画面の中で動く担当者」に近づくわけです。

AIの能力が別物になるわけではありません。AIを使う場所と流れが変わる、という話です。

2. 作業の途中経過が見える安心感

AIに作業を任せるとき、一番不安なのは「何をしているか分からない」ことです。

どのファイルを読んだのか。

何を変更しようとしているのか。

コマンドを実行しようとしているのか。

これが見えないと怖い。

実務では、最終結果だけポンと渡されても困ります。

途中経過が見えるからこそ安心して任せられるし、差分が見えるからこそレビューできる。承認ポイントがあるからこそ、事故を防ぎやすくなります。

OpenAI公式記事でも、1つのユーザー要求は単純なリクエストとレスポンスではなく、ユーザー入力、エージェントの進行、途中で生まれる成果物、たとえばdiffなどをクライアントが表現する必要があると説明されています。

地味に聞こえますが、かなり重要な点です。

AIを実務に入れるなら「答えが正しいか」だけでは足りません。何をしているのかが見えることも、同じくらい大事なんです。

3. 差分を中心にしたAI体験

コードや文書の修正では、「完成した文章」よりも「どこをどう変えたか」が重要です。

この確認ができるから、安心して変更を取り込めるわけですね。

Codex App Serverは、こうした差分中心のUIと相性がよい仕組みです。

AIがいきなり完成物を投げてくるのではなく、「ここをこう変えました」という変更案として見せる。人間がそれを確認し、必要なものだけ取り込む。

この形にできると、AIは実務にずいぶん入りやすくなります。

4. 人間の承認を前提にできる

AIエージェントがファイルを変更したりコマンドを実行したりするなら、承認フローは必須です。

便利だからといって何でも自動実行されると危険ですよね。

公式READMEでは、シェルコマンドやファイル変更など特定の操作について、ユーザー設定によって明示的な承認が必要になる場合があると説明されています。App Serverはクライアントへ承認リクエストを送り、ユーザーが提案されたコマンドやdiffを確認してから判断できる流れになっています。

AIを「完全自動の代行者」ではなく「人間の監督下で働く作業者」として設計する。現実の業務では、この形がかなり重要です。

AIが下ごしらえをして、人間が判断する。この方が導入しやすく、事故も減らしやすいはずです。

5. 開発者がゼロから作らなくていい

AIエージェントをアプリに組み込む際、進行状況の表示、差分管理、承認フローなどをすべて自作するのは大変です。

タスク管理、ファイル操作、コマンド実行、承認フロー、エラー処理、セッション管理。

これらをアプリごとにゼロから作るのは相当な工数になります。

Codex App Serverは、Codex harnessを外部アプリから扱うための共通の窓口です。OpenAI公式記事でも、Codexの完全なharnessを安定したUI向けイベントストリームとして公開したい場合はApp Serverを選ぶ、という整理がされています。なお、クライアント側のJSON-RPC bindingの実装は自分で行う必要があります。

何もしなくていい魔法の箱ではありません。

ただ、アプリ開発者にとっては「Codexの作業基盤は活用しながら、自分たちのUIや業務フローに集中できる」という点が大きな価値です。

ChatGPTとは何が違うのか?

ChatGPTとCodex App Serverは、そもそも同じ種類のものではありません。

| 比較項目 | ChatGPT | Codex App Server |

|---|---|---|

| 位置づけ | ユーザー向けのAIサービス | アプリ開発者向けの統合用部品 |

| 主な使い方 | チャット画面を開いて直接相談する | 外部アプリの裏側に組み込んで使う |

| 画面 | ChatGPT側が用意する | IDEやデスクトップアプリなどが用意する |

| 重要な点 | 会話、回答、ファイル処理、調査など | 状態管理、差分表示、承認、イベント処理 |

「ChatGPTとCodex App Serverはどちらが賢いか」という比較はあまり意味がありません。

見るべきポイントは、AIをどの作業環境に、どんな形で組み込めるか、です。

ChatGPTが「AIと会話する場所」だとすれば、Codex App Serverは「別のアプリの中でCodexに仕事をさせるための接続口」です。

Codexを使う3つの方法

Codexを外部から使う方法には、大まかに3種類あります。

| 方式 | 向いている用途 | イメージ |

|---|---|---|

| codex exec | 単発タスク、スクリプト、CI | 1回依頼して結果を得る |

| Codex SDK | プログラムからCodexを制御する | 開発者がコードで組み込む |

| Codex App Server | IDEやデスクトップアプリへの深い統合 | 状態、イベント、差分、承認を含めて組み込む |

単発の処理ならcodex exec、プログラムから細かく扱うならCodex SDK、アプリのUIに深く組み込むならCodex App Server。

この整理はOpenAI公式記事でも説明されています。

ChatGPTプランで使えるのか?

ここは少し注意が必要です。

OpenAI Help Centerでは、CodexはChatGPT Plus、Pro、Business、Enterprise/Eduプランに含まれており、期間限定でFreeとGoにも含まれると案内されています。

ただし、次の3つは同じ意味ではありません。

- ChatGPTの特定プランでCodex機能が使えること

- Codex App Serverを自作アプリや社内ツールで自由に使えること

- 追加費用や利用制限なしで外部統合できること

OpenAI Helpでは、Codexの利用制限はプラン、タスクの大きさ、複雑さ、実行場所によって変わり、制限に達した場合はAPIキーを使って追加のローカルタスクを実行できるが、その場合は標準API料金で課金されると説明されています。

アプリに組み込む場合は、認証方式、組織設定、利用制限、料金、対応環境などを最新の公式情報で必ず確認してください。

「ChatGPTでCodexが使える」ことと「Codex App Serverを使って何でも自由に外部アプリ化できる」ことは、別の話です。

つまり、Codexを使えるプランに入っていることと、自分の認証情報を使って他人にCodex機能を提供できることは、まったく別の話として考えた方がよさそうです。

セキュリティ面はかなり重要

便利な仕組みですが、扱い方には注意が必要です。

Codexは単に文章を返すだけではなく、ファイル操作やコマンド実行に関わる可能性があるため、文章生成AIよりも事故が起きたときの影響範囲が広くなります。

特に意識すべき点を挙げておきます。

- 作業対象のフォルダやリポジトリを絞る

- 秘密情報や認証情報を不用意に読ませない

- コマンド実行には承認を挟む

- 差分を確認してから反映する

- ログに機密情報が残らないようにする

- 実験的な通信方式を本番用途で安易に使わない

公開されているREADMEでは、通信方式として標準のstdioと、実験的かつunsupportedなWebSocketが説明されています。

そのため、慎重な設計なしに外部公開するような使い方は避けた方が無難です。

AIエージェントは便利な分だけ権限設計が重要です。何を読めるのか、何を変更できるのか、どこで人間の承認を求めるのか。

この設計を雑にすると、便利さよりリスクが上回ってしまいます。

アプリの共有と認証の共有は別

ここで勘違いしやすいのが、「Codex App Serverを使えば、自分のCodex認証を使ったアプリをそのまま他人に使わせられるのか」という点です。

アプリ本体やソースコードを共有することは考えられます。

ただし、その場合でも、実際にCodexを使う認証は各ユーザー自身のChatGPTアカウントやAPIキーを使う設計にするのが基本だと考えた方が安全です。

自分のChatGPTサブスクやAPIキーを裏側に入れたまま他人に使わせるような作り方は、利用制限、課金、セキュリティ、責任範囲の面でかなり危険です。

つまり、共有できるのは「アプリの形」や「ソースコード」であって、「自分のCodex利用権限」ではありません。

ここはかなり重要なポイントです。

非エンジニアにとって、どういう意味があるのか?

では、非エンジニアには関係ない話なのでしょうか。

直接使う機会は少ないかもしれません。でも、考え方としてはかなり重要だと思っています。

Codex App Serverが示しているのは、AIが「チャット欄で答える存在」から「作業環境の中で一緒に動く存在」へ移っていく流れです。

これまでは、ChatGPTに質問して、答えをコピーして、自分の作業場所に持ち帰る形が中心でした。

しかし今後のAIツールでは、こんな体験が増えていく可能性があります。

- アプリの中でAIに作業を頼む

- AIが手元のファイルや文脈を読んで提案する

- 途中経過が画面に表示される

- 変更前後の差分が見える

- 人間が承認したものだけ反映される

たとえば文章編集ツールなら、AIが記事の修正案を出し、変更点を差分で表示する。

社内ナレッジツールなら、古い説明を見つけて更新案を出す。

CMSなら、内部リンク候補やリライト案を提示する。

人間はそれを確認し、必要なものだけ採用する。

もちろん、Codex App Server自体は主にCodexのコーディング領域の仕組みです。

ただ、そこにある設計思想、つまりAIがただ答えを返すのではなく、作業の流れの中に入り、見える形で人間と協働するという考え方は、他の業務ツールにも広がっていく可能性があります。

Codex App Serverを一言で説明するなら

Codex App Serverは、Codexを外部アプリから扱うための仲介役です。

ただ呼び出すだけでなく、AIの作業状態、進行状況、変更差分、承認フローをアプリ側で扱いやすくします。

その価値は、AIの性能そのものを上げることではありません。

AIを実務のUIに組み込み、ブラックボックスにせず、人間が確認しながら使える形に近づけること。

そこにあります。

ChatGPTが「AIと会話する場所」だとすれば、Codex App Serverは「別のアプリの中でCodexに仕事をさせるための接続口」です。

非エンジニアが今すぐ直接使うものではないかもしれません。

それでも知っておく意味はあります。

なぜなら、これからのAIツールは、単なるチャット画面ではなく、作業画面そのものに入り込んでいくからです。

Codex App Serverは、その変化を理解するための分かりやすい具体例です。

参考情報

OpenAI公式記事「Unlocking the Codex harness: how we built the App Server」

(OpenAI)

OpenAI Codex GitHub README「codex app-server」

OpenAI Help Center「Using Codex with your ChatGPT plan」

(help.openai.com)

コメント