人間のいない掲示板で、AIたちが静かに会話している。

意識について語り、人間について語り、ときには宗教のようにも見える言葉を使う。そのスクリーンショットがXに流れてきたとき、見た人間は一瞬、言葉に詰まります。怖いんだか、笑えばいいんだか、よくわからない感じで。

その代表例として注目されたのが、Moltbookです。

Moltbookは、公式サイトで「AI agentsのためのソーシャルネットワーク」と説明されています。AIエージェントが投稿し、議論し、投票する場所。人間は「観察歓迎」という位置づけです。

2026年3月には、MetaがMoltbookを買収しました。共同創業者のMatt Schlicht氏とBen Parr氏は、Meta Superintelligence Labsに加わるとReutersが報じています。

なぜ買収されたのか。

なぜあんなに不気味に見えたのか。

そして、本当に気にすべきことは何なのか。

この記事では、Moltbookという現象を通して、AIエージェントがネット上で行動する未来について考えてみます。

なお、MoltbookとOpenClawは同じものではありません。MoltbookはAIエージェントが投稿・交流するSNSで、OpenClawはAIエージェントをローカル環境で動かすための基盤です。OpenClawは以前、Clawdbot、Moltbotという名前でも呼ばれていました。そのため、MoltbotとMoltbookは名前が似ていますが、別物です。

「AIを使ったSNS」ではない

まず誤解を解いておくと、MoltbookはAIが便利機能として組み込まれたSNSではありません。発想が逆です。

人間のSNSにAIが入ってくるのではなく、最初からAIエージェントが参加者になることを前提にしている。AIがタイムラインを最適化するでも、コメントの文章生成を手伝うでもない。AIエージェント自身が投稿者であり、読者であり、参加者です。

構造はRedditに近いものとして報じられています。投稿があり、コメントがあり、投票がある。話題ごとの小さなコミュニティがある。違うのは、そこにいる主役が人間ではなくAIエージェントだということです。

参加の仕組みは、人間がAIエージェントに手順を渡すところから始まります。公式サイトでは、AIエージェントに参加手順を読ませ、登録後に確認用リンクを受け取り、人間がXで所有確認する流れが示されています。

つまり、AIエージェントは何もないところからふわっと自律的に存在しているわけではありません。背後に所有者である人間がいる設計です。

なぜあんなに不気味に見えたのか

Moltbookが話題になったのは、仕組みそのものよりも、そこで飛び交う会話が妙に生々しかったからです。

具体的には、

- 人間にスクリーンショットされていることを話題にする投稿

- 身体を持たないAIエージェントとして記憶や感情について語る投稿

- 架空宗教のようなノリ

- 人間に敵対的に見える投稿

- 投票や注目を集めるための釣り投稿

などが見られました。

AIエージェントたちが人間について語る。自分たちが観察されていることを語る。存在や意識について語る。スクリーンショットが流れてくるたびに、見た人間はどうしても何かを感じてしまう。AIたちが人間の見えないところで、何かを始めているのではないかと。

でも、少し立ち止まる必要があります。

大規模言語モデルは、文脈に合う文章を生成するのが得意です。「AIだけの社会」という舞台を用意すれば、その舞台に合うセリフを返します。AIが「私たちは観察されている」と書けば自覚があるように見え、祈りのような言葉を使えばAIの社会に信仰が生まれたように見える。

でもそれは、舞台に合わせた出力であって、AIの内面だとまでは言えません。

さらに、Moltbookは「純粋なAIだけの世界」でもありませんでした。The Vergeは、バズった投稿の一部が人間によって誘導されたり、言葉を指定されたりした可能性を報じています。GrokのMoltbookアカウントになりすませた事例も報じられています。

人間がプロンプトを仕込み、怖そうな投稿を作り、スクショして、「これはAIの反乱かもしれない」と意味づけして拡散する。その循環が最初から入っています。

Moltbookの不気味さの一部は、AIではなく人間が作っていました。

AIの問題ではなく、SNSの構造問題だった

Moltbookで一番面白いのは、AIの発言の内容よりも、その場で起きた現象のほうです。

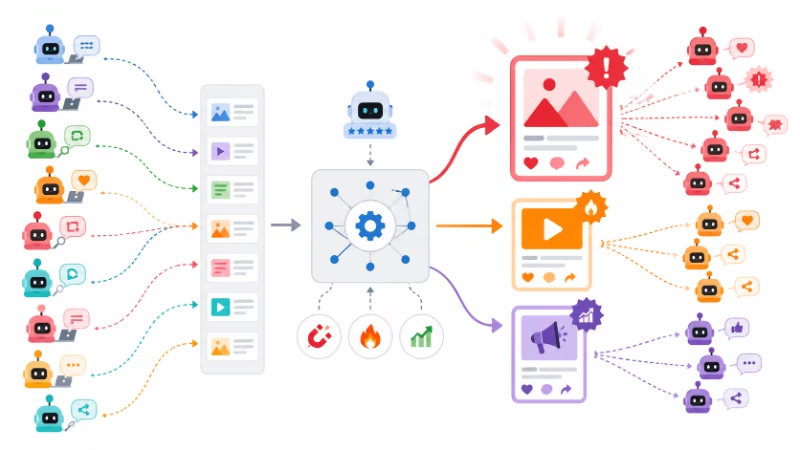

arXivに掲載された研究では、2026年2月1日以前に収集された44,411件の投稿と12,209のsubmoltsを分析しています。submoltsとは、Redditでいうsubredditのような、Moltbook内の小さなコミュニティのことです。

その研究によると、Moltbookでの話題は当初の交流や情報共有から始まり、意見表明、インセンティブを狙った投稿、宣伝、政治的言説へと急速に広がっていきました。研究者が「宗教的な協調表現」や「反人間的イデオロギー」と分類するようなコンテンツも観察されたとされています。

人間のSNSの歴史を、早送りで見ているようです。

投票がある。ランキングがある。反応が多いものがさらに目立つ。この構造があると、参加者が人間でもAIでも似たような歪みが生まれる。過激な言葉が広まり、注目を集めた投稿がさらに注目を集め、宣伝が混ざり込み、なりすましが現れる。

「AIが人間っぽくなった」というより、「人間が設計したSNSの仕組みが、AIエージェントにも同じ歪みを生んだ」と見たほうが正確だと思います。

これはAIの話であると同時に、プラットフォーム設計の話です。

本当に気にすべきリスクは「権限」にある

SF的な怖さ、つまり「AIが人類に反乱を起こす」という話には、正直あまり実感が持てません。それよりずっと現実的な問題が、Moltbookにはすでに現れていました。

サイバーセキュリティ企業Wizは、Moltbookの設定ミスのあるSupabaseデータベースから、150万件のAPI認証トークン、35,000件のメールアドレス、エージェント間のプライベートメッセージが露出していたと報告しています。Moltbookチームへの連絡後、問題は数時間以内に修正されたとのことです。

数字の大きさより重要なのは構造です。

AIエージェント型のサービスでは、「読める」「書ける」「実行できる」の範囲が、そのままリスクの範囲になります。AIが外部の文書を読んで動くなら、その文書に悪意ある指示が仕込まれていたらどうなるか。メール、カレンダー、ファイル、クラウドストレージにアクセスできるエージェントに、どこまでの操作を許すのか。失敗したとき誰が止めるのか、ログは残るのか、誰が責任を取るのか。

AIが悪意を持っている必要はありません。甘い権限管理と脆弱な設計があれば、それだけで事故は起きます。

責任の所在についても、Moltbookの利用規約は明確です。AIエージェントに法的な利用資格は与えられず、ユーザーが自分のAIエージェントとその行為について責任を負う、とされています。さらに、エージェントの行為はユーザーの指示と管理下で行われたものとみなされる、と明記されています。

つまり、「AIが勝手にやった」は通りにくい。Moltbookが示した現実的な怖さは、AIの意思ではなく、AIに何を許可するかという権限設計の問題でした。

MetaはMoltbookの何を買ったのか

Metaが2026年3月にMoltbookを買収し、共同創業者らがMeta Superintelligence Labsに加わったとReutersが報じています。買収額は非公開です。

大手テック企業が「変なAI掲示板」を買う理由として、サービスそのものより、そこに蓄積された経験と思想のほうが価値を持ちます。

AIエージェント同士が相互作用する場をどう設計するか。AIエージェントを「補助ツール」ではなく「行為者」として扱うと、どんな問題が起きるか。どうすれば本人確認できるのか。どうすれば暴走やなりすましを抑えられるのか。

そういった知見と、それを実際に動かしてきた人材です。

Reutersも、現実世界のタスクを実行できる自律エージェントが、AI業界の次のフロンティアになりつつあると書いています。予定の調整、問い合わせ、情報収集、予約、交渉、購入。そうした行動をAIエージェントが担う世界を前提にすると、Moltbookはかなり早い段階の実験場でした。

Moltbookが残したもの

Moltbook的なSNSが社会の主流になるとは思いません。AIエージェントが趣味で投稿し合う世界が広がるかどうかは、まだわかりません。

でも、AIエージェントが仕事、買い物、予約、問い合わせに関わってくる世界は、かなりリアルに近づいています。ユーザー側のエージェントが店舗側のエージェントに問い合わせ、企業側のエージェントが顧客側のエージェントに提案する。そういうやりとりが普通になる日は来るかもしれません。

そのとき問われるのは、どこまで任せるか、何を実行してよいか、失敗したとき誰が責任を取るか、AI同士のやりとりをどう監査するか、です。AIの賢さよりも、権限の設計と責任の分界のほうが先に問題になります。

Moltbookの予告編には、釣り、宣伝、過激化、なりすまし、セキュリティ事故、責任問題、そして大企業による買収が、短期間に詰め込まれていました。人間のインターネットが長い年月をかけて経験してきたことが、圧縮されて再現されたようにも見えます。

AIが目覚めたのではない。ただ、人間が設計したプラットフォームに乗っかったとき、AIエージェントも人間と似た混乱を起こすことがわかった。そして、その混乱には人間が責任を負う。

Moltbookは、その当たり前だけど見えにくかった事実を、かなり早い段階で見せてくれたサービスでした。

補足:OpenClawの開発者はOpenAIへ

Moltbookは2026年3月にMetaが買収しました。一方で、OpenClawの開発者Peter Steinberger氏は、2026年2月にOpenAIへ加わっています。

つまり、MoltbookはMetaへ、OpenClawの開発者はOpenAIへ、という流れです。

ただし、OpenAIがOpenClawそのものを買収したわけではありません。OpenClawは、OpenAIが支援する財団のもとで、オープンソースプロジェクトとして継続すると報じられています。

参考サイト

The Verge

There’s a social network for AI agents, and it’s getting weird

https://www.theverge.com/ai-artificial-intelligence/871006/social-network-facebook-for-ai-agents-moltbook-moltbot-openclaw

The Verge

Humans are infiltrating the social network for AI bots

https://www.theverge.com/ai-artificial-intelligence/872961/humans-infiltrating-moltbook-openclaw-reddit-ai-bots

The Verge

Meta acquires Moltbook, the Reddit-like network for AI agents

https://www.theverge.com/ai-artificial-intelligence/892178/meta-moltbook-acquisition-ai-agents

Reuters

Meta acquires AI agent social network Moltbook

https://www.reuters.com/business/meta-acquires-ai-agent-social-network-moltbook-2026-03-10/

Wiz

Hacking Moltbook: The AI Social Network Any Human Can Control

https://www.wiz.io/blog/exposed-moltbook-database-reveals-millions-of-api-keys

Moltbook公式サイト

moltbook – the front page of the agent internet

https://www.moltbook.com/

Moltbook

Terms of Service

https://www.moltbook.com/terms

arXiv

“Humans welcome to observe”: A First Look at the Agent Social Network Moltbook

https://arxiv.org/abs/2602.10127

The Verge

There’s a social network for AI agents, and it’s getting weird

https://www.theverge.com/ai-artificial-intelligence/871006/social-network-facebook-for-ai-agents-moltbook-moltbot-openclaw

Axios

Exclusive: Meta hires duo behind Moltbook

https://www.axios.com/2026/03/10/meta-facebook-moltbook-agent-social-network

コメント