社外秘のメモを生成AIに貼り付けるとき、一瞬だけ手が止まることはありませんか。

私はあります。

ChatGPTもClaudeも日常的に使っていて、両方に課金もしています。下書きの壁打ち、長文の要約、アイデア出し。もう手放せません。ただ、入力欄にテキストを貼るたびに、その内容がどこかのサーバーに送られていることは事実です。普段はそこまで気にしません。でも、たとえば公開前の企画書、社内向けの人事メモ、まだ誰にも見せたくない文章。こういうものを扱うとき、「これ、送っていいんだっけ」と考える瞬間がある。

その瞬間をなくしたくて、ブラウザだけで動くローカルLLMのチャットツールを作りました。

ツール本体はこちらです。

https://today-is-the-first-day.com/tools/browser-local-llm-chat

インストールは要りません。アカウントも要りません。ブラウザでページを開いて、モデルを選んで、読み込む。それだけで、自分のパソコンの中だけでAIとの会話が始まります。会話の内容は外部サーバーに送信されません。

先に正直に言っておきたいこと

賢さだけで比べたら、ChatGPTやClaudeのほうが上です。

複数の条件を同時に守らせるような複雑な指示。長い文脈を正確に把握したうえでの応答。抽象度の高い議論の整理。こうした作業では、クラウドの大規模モデルが圧倒的に強い。パラメータ数が数百億から数千億あるモデルと、ブラウザで動く数十億パラメータのモデルでは、土台が違います。

このツールは、クラウドAIを置き換えるものではありません。短い文章の下書き、メモの整理、箇条書きの要約、ちょっとしたアイデア出し。こうした軽めの作業を、データを外に出さずに手元だけで済ませる。そこに特化したツールです。

先にこれを書いたのには理由があります。「すごいローカルAIツールがあるらしい」という期待で読み進めて、使ってみたらChatGPTより全然ダメだった、という体験をしてほしくないからです。期待値を正しく持ったうえで触れてもらえれば、「この用途なら十分だな」と感じてもらえるはずです。

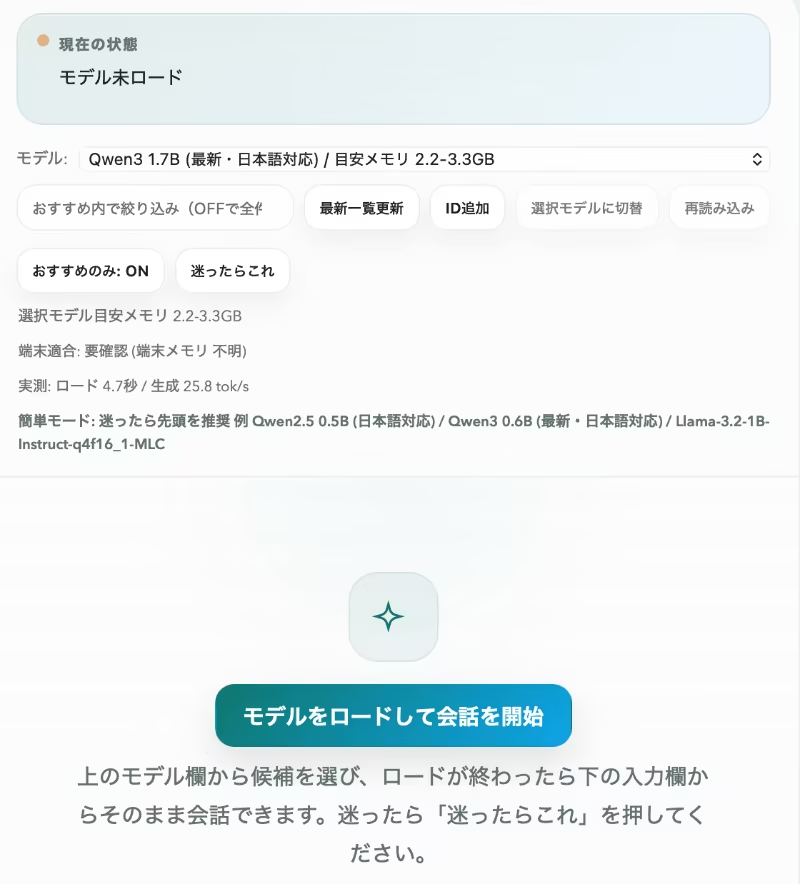

使い方

手順は3つだけです。

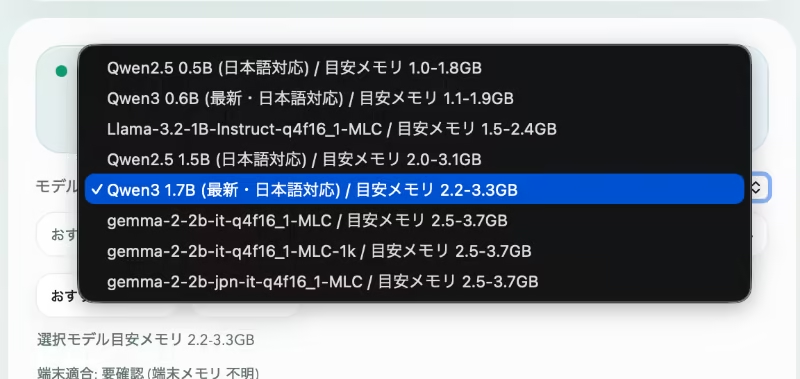

まず、ページを開いてモデルを選びます。最初はQwen3 1.7BかQwen2.5 1.5Bを選んでみてください。迷ったらQwen3 1.7Bで大丈夫です。とにかく軽さを確認したいだけならQwen3 0.6Bでも構いません。

次に、モデルを読み込みます。初回はモデルデータのダウンロードがあるので数分かかります。軽いモデルで1分程度、大きめのモデルでも数分です。Wi-Fi環境を推奨します。2回目以降はブラウザのキャッシュが効くので、10秒から30秒程度で読み込みが終わります。

あとは、そのまま質問を入力するだけです。普段ChatGPTやClaudeに話しかけるのと同じ感覚で使えます。

実際の出力を見てもらうのが一番早い

以下は、M4 iMac(メモリ16GB)でQwen3 1.7Bを動かしたときの出力です。記事用に調整や編集はしていません。ツールに入力して返ってきた内容をそのまま載せています。

「働き方改革について中小企業の視点でアイデアを5つ出して」という指示です。返ってきた内容がこちらです。

- フリーランス型のワークスタイル導入:従業員のライフスタイルを考慮し、曜日や曜日を柔軟に設定し、労働時間の制限を導入。小規模企業の労働コスト削減と、従業員のプライバシーを尊重する。

- リモートワークの支援:オフィススペースの節約と、従業員の自宅で仕事できる環境を提供。特に、若年者や家庭をもつ従業員にとっての働きやすい環境を促進。

- 業務効率化と仕事量のコントロール:仕事量の増減を業務管理システム(例:エクセル、クラウドツール)や担当者との対話で調整。長時間労働の削減と、従業員のモチベーションの向上。

- 週2回の出勤制導入:労働時間の短縮と、従業員の生活の安定を図る。特に、若い従業員の働き方の多様化を促す。

- AIによる業務自動化:顧客対応やデータ入力などの業務をAIで代替。従事者に長時間労働を減らし、業務効率と従業員の休息を両立。

出てくる内容は、ChatGPTやClaudeに同じことを聞いたときほど具体的でも深くもありません。ただ、壁打ちの起点としては十分に機能します。ゼロから自分で考え始めるより、何かしらの叩き台があったほうが進む。そういう使い方です。

もし出力の質が物足りなければ、指示を具体的にしてみてください。「中小企業の製造業で、従業員30人規模で、予算をかけずにできること」のように条件を絞ると、小さなモデルでもかなりまともな答えを返してきます。

機能の一覧

このツールが持っている機能を整理しておきます。

ブラウザ内推論。WebGPUという技術を使って、ブラウザの中で直接AIモデルを動かしています。WebGPUとは、パソコンに搭載されているGPU(グラフィック処理用のチップ)をブラウザから直接利用できる仕組みです。これにより、サーバーを介さずに手元の端末だけでAIの推論処理を実行できます。

日本語向けモデルの選択。Qwen3(0.6B、1.7B、4B)、Qwen2.5(0.5B、1.5B、3B)、Llama 3.2(1B、3B)、Phi 3.5 Mini、Gemma 2 2Bから選べます。日本語で使うならQwenシリーズが最もバランスが良いです。

会話履歴の自動保存。ブラウザのLocalStorageに保存されます。外部送信はありません。ブラウザを閉じても会話は残ります。

PDF、OCR、画像の添付。ファイルの内容もブラウザ内で処理されます。サーバーへのアップロードは発生しません。

JSON形式での書き出しと読み込み。会話データや設定を保存したり、別の環境に移行したりできます。

似たツールとの違い

同じような目的のツールは他にもあります。どれを使えばいいか迷う方もいると思うので、違いを整理しました。

LM Studioは、パソコンにインストールして使うローカルLLMの定番ツールです。モデルの管理やパラメータの調整など、できることが多い。本格的にローカルLLMを運用するなら、最終的にはこちらに進むのが自然です。ただし、最初にアプリをダウンロードしてインストールする手順があります。

Janは、LM Studioと似た位置づけのオープンソースツールですが、デスクトップアプリだけでなくWeb版も提供されており、ローカルモデルに加えてクラウドモデルへの接続にも対応しています。カバー範囲が広いぶん、初回の導入時に選択肢が多く、ローカルLLMだけを試したい人にはやや複雑に感じるかもしれません。

Open WebUIは、サーバーを自分で立てて使うタイプのツールです。複数人での利用や高度なカスタマイズに向いていますが、環境構築にDockerの知識などが必要になります。技術者向けです。

WebLLMは、このツールの内部でも使っているJavaScriptライブラリです。開発者がWebGPU対応のLLMアプリケーションを作るための部品であって、エンドユーザーが直接使うものではありません。

このツールの立ち位置は、それらのどれとも違います。インストール不要、サーバー構築不要、ブラウザだけで完結する。そのかわり、細かいモデル設定やパラメータ調整はできません。「まずローカルLLMがどんなものか触ってみたい」という段階の人に向けて作っています。

| インストール | サーバー構築 | ブラウザ完結 | はじめやすさ | |

|---|---|---|---|---|

| このツール | 不要 | 不要 | ○ | ◎ |

| LM Studio | 必要 | 不要 | × | ○ |

| Jan | 必要 | 不要 | △(Web版あり) | ○ |

| Open WebUI | 必要 | 必要 | × | △ |

データがどこを通るのか

この手のツールで最も大事な情報だと思っています。曖昧にしたくないので、項目ごとに書きます。

会話の内容。外部サーバーには送信されません。入力も出力もブラウザの中で完結しています。

AIの推論処理。ブラウザ内のWebGPUで実行されます。クラウドのサーバーは使いません。

会話履歴と設定の保存。ブラウザのLocalStorageに保存されます。端末の中だけです。

初回のモデルダウンロード。これはインターネット通信が発生します。モデルのデータをHugging Faceのサーバーから取得します。ダウンロードサイズはモデルによって異なりますが、軽いもので数百MB、大きいもので数GBです。

WebGPUライブラリの読み込み。ページを開いたときにJavaScriptライブラリを読み込むため、ここでも通信が発生します。

まとめると、初回のモデル取得とライブラリ読み込みのときだけ通信が発生し、それ以降はモデルがキャッシュに残っていればオフラインでも動く、という構造です。クラウドAIのように、会話のたびに内容がサーバーに送られる仕組みとは根本的に異なります。

対応ブラウザ

Chrome、Edge、BraveなどWebGPUに対応したChromium系ブラウザで動作します。Chromeの場合はバージョン113以降が必要です。

Firefoxについては、WebGPUの対応状況が環境やバージョンによって異なり、現時点ではこのツールでの安定動作を確認できていません。Chrome、Edge、Braveのいずれかを推奨します。

スマートフォンについて。Android版Chromeで動く場合がありますが、メモリやGPU性能の制約があるため、基本的にはPC推奨です。iPhone、iPadについては、SafariのWebGPU対応が進みつつあるものの、環境による差が大きく、現時点では安定動作を確認できていません。PCのChrome系ブラウザを推奨します。

推論速度の目安

ブラウザ上のローカルLLMは、端末の性能に大きく左右されます。以下は私の環境での実測値です。

M4 iMac(メモリ16GB)でQwen3 1.7Bを動かした場合、おおむね毎秒15から25トークン程度の速度が出ています。体感としては、一文ずつ表示されていく速さで、ストレスなく読めるペースです。

4Bクラスのモデルになると速度は落ちます。同じ環境で毎秒8から12トークン程度。少し待つ感覚が出てきますが、使えないほどではありません。

これはあくまで私の環境での目安であり、端末のGPU性能やメモリ量によって大きく変わります。古いパソコンや、GPUが非力な端末では、これより遅くなるか、そもそもモデルの読み込みに失敗する場合があります。まず軽いモデル(Qwen3 0.6BやQwen2.5 0.5B)から試して、動くことを確認してから大きいモデルに進むのがおすすめです。

向いている人、向いていない人

向いているのは、たとえばこういう場面にいる人です。

社内の議事録を要約したいが、議事録の内容は社外に出せない。クライアントから預かった資料を整理したいが、守秘義務があるのでクラウドAIに貼れない。公開前の企画書を壁打ちしたいが、まだ社内にも共有していない段階で外部サービスに送るのは気が引ける。こういう場面で、手元だけで完結するAIがあると助かります。

また、ローカルLLMに興味はあるけれど、いきなり環境構築をするのは面倒だという人にも向いています。LM Studioのインストールやモデルファイルの管理をする前に、まずブラウザで感触をつかんでみたい。そういう段階の方です。

チームや社内で「ローカルLLMとは何か」を体験共有したい場合にも使いやすいはずです。URLを共有するだけで全員が同じツールを試せるので、勉強会や検証の起点になります。

逆に向いていないのは、ChatGPTやClaudeと同等の応答品質をローカル環境に求める人です。小さなモデルでは複雑な指示への対応力や長文生成の品質に明確な差があります。また、すでにLM StudioやOllamaで本格的な環境を組んでいる人にとっては、機能的に物足りないはずです。

弱点

初回はすぐに使えません。モデルのダウンロードに数分かかります。これはインターネット経由でモデルデータを取得する必要があるためで、避けられません。2回目以降はキャッシュが効くので速いですが、初回の体験はどうしても待ちの時間が入ります。

端末の性能に左右されます。WebGPUを使うとはいえ、ブラウザ上での推論はネイティブアプリと比べて効率が落ちます。メモリが8GB未満の端末や、数年前のGPUでは、大きめのモデルが動かないことがあります。

モデルのキャッシュ管理はブラウザ任せです。ブラウザの設定でキャッシュをクリアすると、モデルデータも消えます。その場合は再度ダウンロードが必要になります。

ブラウザで動く以上、デスクトップアプリほどの安定性はありません。ブラウザの相性や、環境固有の問題が起きる可能性はあります。

なぜ作ったのか

きっかけは、クライアントから預かった資料の内容をChatGPTで整理しようとして、手が止まったことでした。守秘義務のある内容をクラウドに送るわけにはいかない。でも手作業で整理するには量が多い。

ローカルLLMの存在は知っていました。ただ、そこにたどり着くまでが面倒でした。GPUの要件を調べ、ターミナルで環境を構築し、動かなければエラーログを読んで直す。興味はあるのに、始める前に疲れてやめてしまう。

だから、ブラウザを開くだけで触れる場所を作りました。

ツール本体

こちらからすぐに試せます。

https://today-is-the-first-day.com/tools/browser-local-llm-chat

ブラウザを開いて、モデルを選んで、読み込む。それだけで始められます。

よくある質問

日本語で使うならどのモデルがいいですか。

Qwen3 1.7BかQwen2.5 1.5Bがバランスが良いです。軽さ優先ならQwen3 0.6Bを試してください。

初回ダウンロードはどのくらいかかりますか。

軽いモデルで1分程度、大きめのモデルで数分です。通信環境に依存します。2回目以降はブラウザのキャッシュが効くので大幅に短縮されます。

オフラインでも使えますか。

初回ダウンロード後、モデルがブラウザのキャッシュに残っていればオフラインで利用できます。ただし、キャッシュをクリアするとモデルデータも消えるため、再度ダウンロードが必要になります。

スマートフォンでも使えますか。

Android版Chromeで動作する場合がありますが、メモリやGPUの制約により不安定なことがあります。iPhone、iPadは環境による差が大きく、安定動作を確認できていません。PCのChrome系ブラウザを推奨します。

会話データはどこに保存されますか。

ブラウザのLocalStorageに保存されます。端末の中だけで、外部サーバーには送信されません。

ChatGPTやClaudeの代わりになりますか。

なりません。応答の質ではクラウドAIが上です。データを外に出したくない場面で、このツールの出番があります。

WebGPUに対応しているか確認する方法はありますか。

Chromeでこのツールのページを開いてモデルの読み込みを試すのが最も確実です。WebGPUが利用できない環境では、読み込み時にエラーが表示されます。

コメント