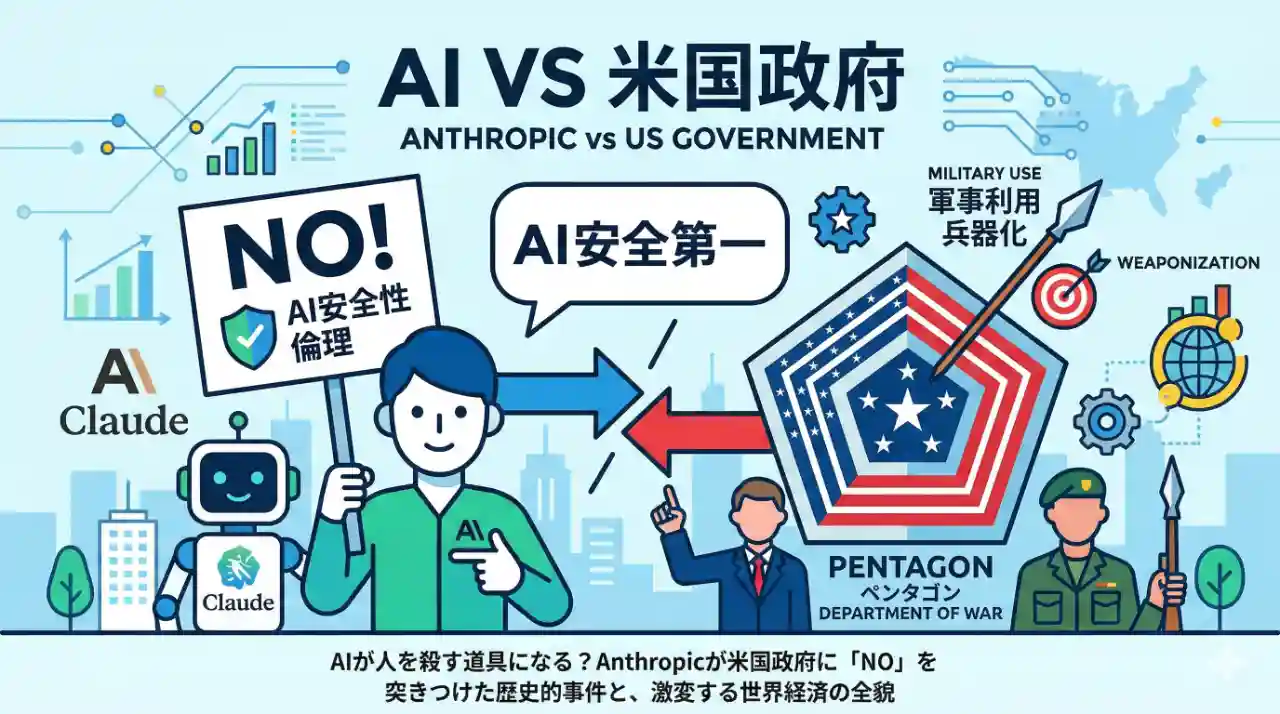

2026年2月27日、金曜日。Anthropicとペンタゴンの交渉は決裂した。

この記事では、何が起き、なぜ決裂したのかを時系列で整理する。後半では私自身の考察を述べる。前半は報道と一次情報に基づく事実の整理に徹するが、私が直接取材したものではなく、各メディアの報道と当事者の公式発表が情報源の中心であることは最初に断っておきたい。考察に入るときは明確に区切る。

ただし、ひとつだけ先に言っておきたいことがある。この記事を最後まで読んでも「どちらが正しかったのか」に対する明快な答えは出てこない。出てくるのは、もっと厄介な問いだ。AIが人の生死に関わる判断に使われるとき、そのルールは誰が決めるべきなのか。2026年2月27日の出来事は、その問いがもう仮定の話ではなくなったことを突きつけている。

Anthropicという会社の成り立ち

この対立が何を意味するのかを理解するには、Anthropicがどういう経緯で生まれた会社なのかを知っておく必要がある。

Anthropicは2021年、サンフランシスコで設立されたAI企業だ。AIアシスタント「Claude」を開発しており、ChatGPTを作っているOpenAIと並ぶ世界トップクラスのAI企業のひとつとされている。2026年2月のシリーズG資金調達時の評価額は3,800億ドル(約55兆円)。年間売上のランレート(直近の実績を年換算した数字)は140億ドル規模と発表されている。

創業者のダリオ・アモデイとダニエラ・アモデイの兄妹は、もともとOpenAIの中枢にいた。しかし、OpenAIの商業化の進み方に強い危機感を持ち、AIの安全性により重きを置く組織が必要だと考えるようになって、2021年に仲間を連れて独立した。

つまり、Anthropicにとって「安全なAIを作る」は、あとから付け加えたスローガンではない。会社を作った理由そのものだ。この出発点が、今回の対立のすべてに関わってくる。

2025年夏。契約の始まり

Anthropicとペンタゴンは、もともと敵同士ではなかった。むしろパートナーだった。

2025年6月、Anthropicは米国の国家安全保障機関向けに「Claude Gov」モデルを発表した。翌7月14日には、国防総省との間で2年間、上限2億ドル(約290億円)の契約を公表している。Anthropicの公式発表によれば、Claudeは軍の機密ネットワーク上で稼働するAIモデルのひとつとなり、インテリジェンス文書の要約や膨大な書類の処理といった実務に使われた。

ただし、この契約にはAnthropicの利用規約が組み込まれていた。Anthropicが公開している「Exceptions to our Usage Policy」によれば、国家安全保障分野での利用を許可する一方で、偽情報の生成、悪意あるサイバー作戦、検閲、国内監視など複数の禁止事項が維持されている。そのうち、今回の交渉で争点となった禁止線は主に2つある。

ひとつは、アメリカ市民に対する大規模な国内監視活動への利用。

もうひとつは、完全自律型致死兵器への組み込み。人間の指示なしにAIが標的を判断し、攻撃や殺傷を行う兵器にClaudeを使うことだ。

なお、利用規約にはこの2点以外にも複数の禁止事項が含まれているが、後述するように、ペンタゴンとの交渉で明確な争点として浮上したのは主にこの2つだったとAnthropicの2月27日付声明に記されている。

ペンタゴンはこの条件を受け入れて契約した。当時は、それで問題なかった。

ではなぜ、ペンタゴンはその後「制限なく使いたい」と要求するようになったのか。その背景には、AI企業の視点とはまったく異なる風景がある。次の節で掘り下げる。

ペンタゴンから見えている風景

この対立を理解するには、ペンタゴンがなぜあれほど強硬だったのかを、ペンタゴンの側から見る必要がある。「横暴な国家権力 vs 高潔なAI企業」という単純な構図では、この問題は捉えきれない。

アメリカの国防当局が見ている世界では、中国が軍民融合政策のもとでAIの軍事応用を国家戦略として推進している。ロシアもウクライナ戦争を通じて自律型ドローンの実戦投入を加速させている。こうした競争相手が、自国のAI企業に倫理的な制約をかけているとは考えにくい。ペンタゴンから見れば、「アメリカのAI企業だけが使い方を制限するのは、戦略的に不利になる」という危機感は、理不尽なものではない。

しかしペンタゴンの苛立ちには、もうひとつの層がある。技術競争の一般論よりも具体的で、切実な層だ。

それは「いざというとき使えるのか」という運用上の信頼性の問題だ。

軍事技術の調達において、「有事にベンダーの利用規約を確認しないと動かせないかもしれない」という不確実性は、それ自体が重大なリスクとみなされる。兵器システムに求められるのは、必要なときに確実に動くことだ。どんなに優れたAIでも、緊急時に外部の民間企業の判断を仰がなければ使えない可能性があるなら、軍にとっては信頼できるシステムとは言えない。

後述する『核ミサイルの仮定』のエピソードも、この文脈で読むことができる。あれは単なる思考実験ではなく、『民間企業のルールが軍事的な信頼性を損なうのではないか』というペンタゴン側の懸念を、極端な形で示したものだった可能性がある。

さらに、ペンタゴンには時間軸の問題もある。AIの能力は急速に向上しており、今日の制約が明日の戦略的不利に直結しうる。3日間という異例の短期限の背景に、中国との競争を強く意識した切迫感があった可能性はある。もちろん、これは推測を含む見立てだ。ただ、期限設定を単に『横暴』とだけ見るのではなく、なぜそこまで急いだのかを考えることは、この対立を理解する助けになる。

この節で述べたことは、ペンタゴンの行動を正当化するためではない。その論理を内側から理解するための補助線として読んでほしい。

2025年12月。核ミサイルの仮定

水面下での緊張は、報道されるよりも前に始まっていた。

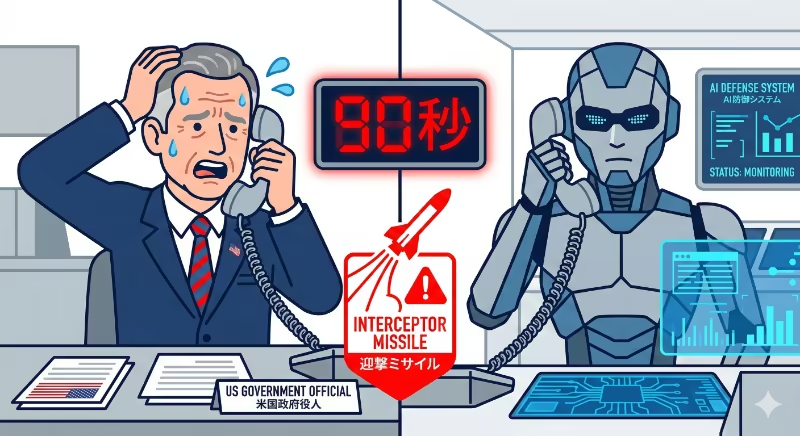

Washington Postの報道によれば、2025年12月、国防総省の研究開発担当次官エミル・マイケル氏がアモデイCEOに電話をかけた。マイケル氏はこんな仮定の話を持ち出したとされる。

「核弾頭を搭載した大陸間弾道ミサイルがアメリカに向かって飛んでいる。残り90秒。Claudeだけがそれを迎撃できる。でもAnthropicのルールがそれを阻んでいる。あなたはどうする?」

ペンタゴン側の証言として報じられたところでは、アモデイCEOは「それはこちらに連絡してくれれば、一緒に考えます」と答えたという。ペンタゴン側はこの返答を「核が飛んでくる緊急事態に、まずAI企業に電話しろと言うのか」と受け止めたとされる。

一方、Anthropic側はこの証言を否定している。2026年2月27日付の公式声明で、Anthropicは「ミサイル防衛への利用は認めると伝えていた」と主張した。

どちらの言い分が正確なのかは、外部からは判断できない。しかし、先ほどの節で述べた「いざというとき使えるのか」というペンタゴンの懸念に立って考えると、このやりとりの持つ意味が見えてくる。

マイケル次官の問いかけが求めていたのは、おそらく「はい、その場合はルールを外します」という無条件の保証だ。しかしアモデイCEOの側から見れば、あらゆる仮定のシナリオに対して「ルールを外します」と答えてしまえば、ルールは実質的に存在しないのと同じになる。例外を認め始めたら歯止めがなくなるという懸念は、安全性を看板に掲げる企業にとっては譲れない一線だったはずだ。

つまり、この電話は単なるエピソードではなく、両者の立場が構造的に両立しないことを予告するものだったとみることもできる。ペンタゴンは『緊急時に確実に使える保証』を求め、Anthropicは『例外を作らないことがルールの本質だ』と考えていた。この溝は、後の交渉決裂の伏線としてすでにこの時点で存在していた。

2026年1月。ベネズエラ作戦

年が明けて、事態はさらに動いた。

2026年1月、アメリカ特殊部隊がベネズエラに突入し、独裁者ニコラス・マドゥロを拿捕する作戦が実行されたと報じられている。AxiosやWall Street Journalによれば、この作戦にClaudeが使われていた。

Anthropic側は「利用規約に違反した使われ方はされていない」という立場を維持した。禁止されていたのは「大規模監視」と「完全自律型致死兵器への組み込み」であり、作戦の計画立案や情報分析の支援は契約上許容される範囲だったという判断だ。

しかし、この時期にひとつの出来事が報じられている。

NBC Newsなどによれば、Anthropicのある幹部が、AIソフト企業Palantirの幹部に対して「ベネズエラ作戦でClaudeがどのように使われたのか」と問い合わせた。Palantir側はこれを「Anthropicが軍事利用に異議を唱えようとしている」と受け止め、ペンタゴンに報告したとされる。

ペンタゴンはこの問い合わせを強く問題視したと報じられている。Anthropicは「通常の技術的な確認に過ぎない」と否定した。

この件について注意すべきことがある。Palantir幹部への問い合わせの詳細は、主にペンタゴン側の認識を通じて報じられたものであり、Anthropic側の内部事情については十分な情報がない。したがって、この問い合わせの意図が実際にどういうものだったのかを断定することはできない。ただし、どちらの意図であったにせよ、この件が両者の関係をさらに悪化させる要因になったことは、複数の報道が一致して伝えている。

ここには、構造的な認識のギャップがある。Anthropicからすれば、自社の技術がどう使われているかを確認するのは責任ある行動だ。しかしペンタゴンからすれば、機密性の高い軍事作戦について民間企業が「使い方を監査しようとしている」と映る。軍事組織にとって、作戦の詳細を外部に説明する義務はない。

どちらが正しいかではなく、この認識のギャップそのものが、契約関係を維持不能にしていった。

2026年2月24日。最後通牒

2月24日、火曜日。Axiosの報道によれば、ヘグセス国防長官がアモデイCEOを呼び、直接会談を行った。会談には複数の国防総省幹部が同席したとされる。

報道によれば、ヘグセス長官の要求は明快だった。Claudeを「すべての合法的目的のために」制限なく使えるようにすること。つまり、Anthropicが維持してきた禁止条項を契約から外すよう求めた。

期限は2月27日、金曜日の午後5時1分。

応じなければ、ペンタゴンはAnthropicとの契約を打ち切り、「サプライチェーンリスク」に指定する。さらには冷戦期に制定された「国防生産法」を使って技術提供を強制することも検討していると告げたと報じられている。

3日間という期限は、交渉の余地を与えるにはあまりに短い。なぜペンタゴンがそこまで急いだのかについては先の節で触れたが、仮にペンタゴン側に切迫した事情があったとしても、これは事実上、受け入れるか拒否するかの二者択一を迫るものだった。

2026年2月27日。決裂

2月27日。交渉は決裂した。

この日の出来事の正確な前後関係については、報道によって記述に揺れがある。NPRは「トランプ大統領のTruth Social投稿は、ペンタゴンが設定した期限の約1時間前だった」と報じている。つまり、期限が切れるのを待たずに対抗措置が発表された可能性がある。一方、他の報道では期限後に措置が取られたかのように書かれているものもある。正確な時系列は確定できないが、確かなのは、この日のうちに事態が一気に動いたということだ。

NPRなどの報道によれば、トランプ大統領はTruth Socialですべての連邦機関にAnthropicの技術の使用停止を命じた。投稿の内容は「Anthropicの左翼ナットジョブたちは、国防省を自分たちの利用規約に従わせようとする壊滅的な過ちを犯した。だから私はすべての連邦機関に、即時Anthropicの技術の使用停止を命じる」というものだったとされる。さらにヘグセス国防長官にAnthropicの「サプライチェーンリスク」指定を指示した。

ヘグセス長官もXで声明を出し、「Anthropicは傲慢と裏切りのマスタークラスを見せた」と述べたとされる。エミル・マイケル次官はXに「アモデイは嘘つきだ。神のコンプレックスを持っている」と投稿したと報じられている。

Anthropicは2月27日付で公式声明を発表した。声明の要旨はこうだ。

ペンタゴンが提示した妥協案は表面上は合理的に見えるが、「いつでもこのルールを無効にできる」という抜け穴が含まれていた。自分たちは何年も後に、AIの能力が今よりはるかに広がる時代を見据えている。だから曖昧な合意では意味がなく、未来のリスクに対する明確な禁止が必要だ。これらの脅しによっても立場は変わらない。

CBSニュースのインタビューに応じたアモデイCEOはこう語ったと報じられている。「政府に異議を申し立てることは、最もアメリカ的な行為だ。私たちは愛国者だ」。

なお、Anthropicが「サプライチェーンリスク」指定の正式な通知書を受領したのは3月4日であり、それを公表したのは翌5日だった。指定に向けた動きは2月27日に始まったが、手続き上の完了はその後のことである。

「サプライチェーンリスク」指定とは何か

この指定が実際にどういう効果を持つのかを整理しておきたい。正確に理解しないと、この出来事の大きさを見誤る。

「サプライチェーンリスク」指定は、合衆国法典第10編第3252条に基づく。この条文は「covered procurement action」、つまり国防総省の調達行為に関わる枠組みで書かれている。

Anthropicの2月27日付公式声明には、『歴史的に米国の敵対国に対して適用されてきたものであり、アメリカの民間企業に公に適用された前例はない』と書かれている。複数の報道も、これを異例の措置として伝えている。

この指定の直接的な効果は、国防総省とその契約業者がAnthropicの技術を軍事関連業務で使用することを制限するものだ。民間企業や外国政府がClaudeを利用すること自体を直接禁じるものではない。アモデイCEO自身も「narrow scope(限定的な射程)」だと述べたと報じられている。Anthropicは3月5日の公式文書でも、この指定の射程は国防総省契約に関わる使用に限られると説明している。

つまり、Anthropicはアメリカ政府全体から排除されたわけではなく、国防総省の調達網から外される方向が明確になったということだ。

ただし、その影響は直接的な売上の喪失にとどまらない。防衛関連のサプライチェーンに組み込まれた企業が「リスク」と名指しされること自体が、他の政府機関や民間企業との取引にも間接的な萎縮効果を持ちうる。制度の射程が限定的であっても、「ペンタゴンに危険視されている企業」というレッテルの影響力は、制度の文面を超えて広がる可能性がある。

Anthropicは法的措置を宣言した。「この指定は法的根拠がなく、アメリカの民間企業に対して外国の敵対企業向けの措置を適用した前例のない行為だ」と反論した。

日本への直接的な影響については、現時点ではほぼない。「サプライチェーンリスク」指定は米国防総省とその契約業者に関するものであり、日本の一般企業や個人がClaudeを使うことには影響しない。

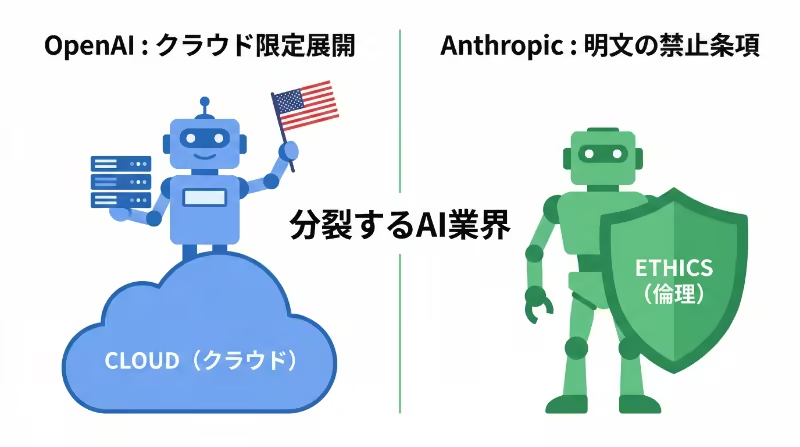

OpenAIはなぜペンタゴンと合意できたのか

多くの人が疑問に思うだろう。OpenAIもAnthropicも、かつてはAIの軍事利用について似たような懸念を表明していた。なぜ片方は合意でき、片方は決裂したのか。

答えは少なくとも2つの層に分かれる。

第一の層は、技術的アプローチの違いだ。

Anthropicのアプローチは、契約の文言で禁止事項を定めるものだった。「大規模監視に使ってはいけない」「完全自律型致死兵器に組み込んではいけない」と明記し、法的な拘束力で歯止めをかける。

OpenAIが選んだのは、技術設計そのもので制約をかけるアプローチだった。OpenAIはペンタゴンに対して「クラウド環境のみへの展開」を提案した。2026年2月28日付のOpenAI公式ブログにはこう書かれている。

「これはクラウド限定の展開であり、エッジデバイスへのデプロイは行わない。自律型致死兵器への使用にはエッジ展開が必要となるため、私たちの展開アーキテクチャにより、これらのレッドラインが越えられていないことを独自に検証することが可能だ」

さらにOpenAIは「もし我々のモデルがあるタスクを拒否したとしても、政府はそれを強制的にやらせることはできない」という約束も取り付けた上で、ペンタゴン側の「すべての合法的目的のために使用できる」という文言を受け入れた。3月2日の追記では、国内監視への不使用も明文化されている。

同じブログにはこうも書かれている。「我々の合意は、Anthropicの元々の契約を含む、これまでの機密AI展開に関するいかなる合意よりも多くのガードレールを持っていると考える」。これはOpenAI側の自己評価であり、第三者が検証したものではない。

第二の層は、政治的な関係性の違いだ。

OpenAIのサム・アルトマンCEOはトランプ大統領の就任式に出席し、大規模AIインフラ計画「Stargate」でも政権と協力関係にあったと複数のメディアが報じている。交渉というものは、技術的な提案の中身だけで決まるわけではない。交渉に臨む前の関係性、信頼の蓄積、あるいは政治的な近さが、合意の成否に影響することは珍しくない。

両社の結果の違いが、純粋に技術的アプローチの優劣によるものなのか、政治的関係性の差によるものなのか、あるいはその両方なのかは、公開情報からは断定できない。ただし、この2つの要素を切り離して議論することには無理がある。

同じ朝のOpenAIの資金調達

2月27日の朝、報道各社によれば、OpenAIが1,100億ドル(約16兆円)規模の資金調達を発表した。OpenAIの公式発表ではAmazonが500億ドルを投資しAWSがOpenAIの企業向けプラットフォーム「OpenAI Frontier」の独占的なサードパーティ配信パートナーとなることが明示されている。報道ではこのほかにNvidia(300億ドル)、SoftBank(300億ドル)の名も挙げられている。一方、Microsoftは同日の共同声明で「AzureはOpenAI APIの独占的クラウド提供者であり続ける」「OpenAIのファーストパーティ製品はAzure上でホストされ続ける」と説明した。AmazonとMicrosoftが異なる領域でOpenAIを支える構造だ。

ここで触れておくべき事実がある。AnthropicにとってAmazonは最大級の出資者でもある。そのAmazonが、同じ日にOpenAIに500億ドルを投じた。

この日付の一致が意図的なものであったことを示す報道や証拠は、現時点では確認できていない。しかし、この一致が持ちうる意味については考える価値がある。具体的に言えば、資本を提供する側(Amazon、SoftBank、Nvidia)にとって、AI企業が政府と対立して調達網から外されるリスクは、投資判断に無関係ではありえない。Anthropicの決裂とOpenAIの巨額調達が同じ日に起きたことは、AI産業において「政府との関係を維持できること」が資本を引きつける条件のひとつになりつつある可能性を示唆している。

これは私の解釈であり、事実として確認されたものではない。ただ、この力学を無視して2月27日を語ることもできないと考えるため、ここに記しておく。

外部の反応

Georgetown大学のローレン・カーン研究員はCNBCで「誰も勝者はいない。誰の口にも苦い後味が残る」と述べたと報じられている。

戦略国際問題研究所(CSIS)のグレゴリー・アレン顧問はBloomberg Radioで、「いまの政府がAI競争を冷戦期の宇宙開発競争に例えている最中に、自国のAI産業の宝を燃やすようなことをしている」と語ったとされる。

報道によれば、Anthropicの社員だけでなくGoogleやOpenAIの社員も含めた数百人規模が公開書簡に署名し、「大規模監視と、人間の判断なしに人を殺すことへのAI利用に反対するAnthropicを支持する」と表明した。ただし、この署名者数は報道機関によって300人超から450人超まで幅があり、正確な人数は確定していない。また、AI業界全体の就業者数から見れば、いずれの数字も限定的だ。

以上が、一次情報と報道を通じて確認できるこの対立の経緯だ。

ここから先は、事実の紹介ではなく、私個人の解釈と考察になる。

これまで両者の論理をできるだけ公平に追ってきたが、ここからは私自身の判断を述べる。公平であることと、判断を持たないことは違う。事実を丁寧に追ったからこそ、言えることがある。

「クラウド限定」は安全装置として十分か

OpenAIの「クラウド限定」アプローチについて掘り下げたい。

この設計の論理は、工学的には筋が通っている。AIモデルがドローンや兵器の端末に直接搭載されていなければ、機体の中で自律的に「この標的を攻撃する」と判断することはできない。さらに、クラウド上のAPIはすべての呼び出しがログに残るため、後から「何にどう使われたか」を監査できる。契約の文言の解釈に頼るよりも、物理的・技術的な制約と監査ログの組み合わせの方が確実だという発想には合理性がある。

しかし、この仕組みが本当に「AIが殺傷の判断に関与しない」ことを保証するかどうかは、別の問題だ。

具体的なシナリオを想像してほしい。

クラウド上のAIが衛星画像を分析し、「この建物に標的がいる確率は92%」と出す。その結果は、遠く離れた基地にいるオペレーターの画面に表示される。オペレーターはそれを確認し、承認ボタンを押す。攻撃命令が下流のシステムに送られる。

この流れにおいて、AIは端末に搭載されていない。人間が最終判断を下している。形式的には「自律型兵器」の定義には当てはまらない。

しかし実質的にはどうか。

この問題は、心理学や人間工学の分野で「オートメーション・バイアス(自動化偏向)」と呼ばれる現象としてよく研究されている。人間は、コンピュータやAIが出した判断を過度に信頼する傾向がある。特に時間的圧力が高い状況、情報量が多すぎて自力では処理しきれない状況、そして判断を間違えたときの責任が重い状況では、この傾向が強まることがわかっている。代表的な研究として、Parasuraman & Manzey(2010)の “Complacency and Bias in Human Use of Automation” などが挙げられる。

戦場はこの3つの条件をすべて満たす。

「92%の確率で標的がいる」と画面に表示されているとき、オペレーターが「いや、自分の直感ではこの判定は間違っている」と言ってボタンを押さないという判断を下すのは、理論上は可能だ。しかし、時間的圧力の中で、AIの分析を覆す独自の根拠を示す必要がある状況で、それが現実的にどれほど起きるか。

「AIが端末に搭載されていないこと」と「AIが殺傷の判断に実質的に関与していないこと」は、同じではない。

ではAnthropicの契約アプローチなら、この問題を防げたのだろうか。それも怪しい。「完全自律型致死兵器に使ってはいけない」と契約に書いてあっても、上で描いたワークフローが「完全自律型」に該当するかどうかは、定義次第でどちらにも転ぶ。人間がボタンを押している以上、形式的には「自律型」ではないと主張できてしまう。

つまり、両方のアプローチに同種の盲点がある。技術的制約も契約的制約も、AIが殺傷の意思決定に実質的に関与するグレーゾーンを、単独では塞ぎきれない。

ここで私の考えを述べる。

おそらく現実的な解は、ひとつのアプローチに頼ることではなく、複数の層を重ねることだ。技術的な設計制約で物理的にできることを限定し、同時に契約と法律で使い方のルールを明文化し、さらに独立した第三者が定期的に監査する。しかし今回の対立では、そうした折衷案が成立する余地はなかった。ペンタゴンは「制限なく使わせろ」と迫り、Anthropicは「禁止条項は外せない」と返した。交渉の構図そのものが、妥協を許さないものだった。

そしてこの構図には、より根本的な問題がある。「複数の層を重ねる」という解を実現するためには、企業と政府が対等に交渉できることが前提になる。しかし2月27日に起きたことは、その前提自体が脆いことを示している。政府が「3日以内に応じなければサプライチェーンリスクに指定する」と言えてしまう力関係の中で、対等な交渉は成り立つのか。この問いに対する私の答えは悲観的だ。企業の自主規制だけでは、この種の圧力に長期的に耐えることはできないだろうと考えている。

2015年のAppleと2026年のAnthropic

テック企業が政府の要求を断った先例として、多くの人がAppleの事例を思い浮かべるだろう。比較する価値はあるが、同時に、両者の違いも正確に見ておく必要がある。

2015年12月、カリフォルニア州サンバーナーディーノで銃乱射事件が起きた。FBIは犯人のiPhoneの暗号を解除するソフトウェアをAppleに作るよう求めた。根拠は「All Writs Act(全令状法)」という、合衆国建国初期にまで遡る法律に基づく裁判所命令だった。テロ事件の捜査という文脈での、法的強制力のある要求だ。

ティム・クックは断った。Appleの公開書簡にはこう書かれていた。FBIが求めているのは、これまで存在しなかったものだ。一度そのソフトウェアが存在してしまえば、何度でも、どのデバイスにでも使えるようになる、と。

結局FBIは別の手段でiPhoneをアンロックし、法的手続きを取り下げた。Appleは「勝った」わけでも「負けた」わけでもないが、自分たちの一線を守った。その後、「プライバシーのApple」というブランドは別次元の強度を持つようになった。政府の命令を実際に断ったという事実が、言葉を裏打ちしたからだ。

Anthropicにも似たことが起きる可能性はある。「政府の圧力にNOと言えるAI企業」という位置づけは、医療や法律、ジャーナリズムのように、情報の機密性が生命線となる分野で、他社との差別化要因になりうる。

ここまでは表面的な類似だ。しかし、掘り下げると重要な違いが3つある。

第一に、法的な文脈が違う。Appleが抗ったのは裁判所命令という法的強制力を持った要求だった。Anthropicの場合は、契約交渉の決裂だ。ペンタゴンは「国防生産法」の適用も示唆したとされるが、実際にはそこまで踏み込んでいない。法的強制力の質がまったく異なる。Appleが「法的命令を断った」のに対して、Anthropicは「契約条件の変更を断った」のであり、抵抗の性質が違う。

第二に、技術的な不可逆性の構造が違う。Appleの主張の核心は「一度バックドアを作ったら、それは取り消せない」という技術的な不可逆性にあった。ソフトウェアは複製でき、流出しうる。だから「作ること自体」を拒否するしかなかった。Anthropicの禁止条項は、理論上は再び付け加えることもできる。契約条件の変更は、技術的な不可逆性とは性質が異なる。

第三に、ビジネスモデルの構造が違う。Appleがプライバシーをブランドの柱にできたのは、iPhoneの販売で収益を得るビジネスモデルがあったからだ。プライバシーを守ることと、iPhoneを売ることが、同じ方向を向いていた。原則を貫くことがそのまま商業的な強みになるという幸運な構造があった。

Anthropicにはこの構造がない。API課金と企業向け契約で収益を得ているAnthropicにとって、国防総省の調達網から外されることは、顧客基盤の一部を直接失うことを意味する。信念を守ることのコストが、より直接的で、より重い。

もうひとつ付け加えておきたいことがある。Appleの「政府に屈しなかった」という物語には後日談がある。2018年、Appleは中国政府の要求に応じて、中国ユーザーのiCloudデータを中国国内のサーバーに移管した。企業の原則は、文脈が変われば、実践のされ方も変わる。Anthropicが今後、異なる種類の圧力に直面したときに同じ判断ができるかは、わからない。

この対立が残したもの

ベネズエラ作戦でClaudeは実際に使われたと報じられている。イスラエルがガザで標的識別にAIシステムを使用しているとの複数の報告がある。AIを使った軍事的判断の自動化は、もはや仮定の話ではない。

ペンタゴンには、中国やロシアとのAI軍事競争で後れを取れないという切実な理由がある。Anthropicには、自分たちが作った技術が人間の判断を経ずに人を殺す未来を防ぎたいという、会社の存在理由に関わる信念がある。どちらの論理も、その立場から見れば合理的だ。

OpenAIは「クラウド限定」という第三の道を提示した。それが本当に安全装置として機能するかどうかは、技術的にも制度的にも、まだ検証されていない。

この記事の前半で、私は両者の論理を公平に追うことに徹した。後半では、クラウド限定アプローチの限界やApple比較の非対称性について私の判断を述べた。最後に、この対立から引き出すべき問いについて書いておきたい。

この対立から引き出すべき最も重要な問いは「Anthropicとペンタゴンのどちらが正しかったか」ではない。それは、AIが人間の殺傷に関与する際のルールを、誰が、どのような手続きで、どのような基準で決めるべきなのか、という問いだ。

今回、そのルールは、ひとつのAI企業の利用規約と、ひとつの政府機関の要求と、3日間の最後通牒によって決められようとした。そしてそれが決裂したとき、結果を決めたのはTruth Socialへの投稿だった。

AIが殺傷に関与するかどうかの判断が、この方法で行われるべきだと考える人は少ないだろう。

しかし、ではどうすべきなのか。

ここで、私が考える方向性と、その方向性がなぜ実現困難なのかを、正直に書いておきたい。

第一に、AIの軍事利用に関するルールを、企業の自主規制でも行政府の裁量でもなく、立法府が法律として定めること。少なくとも今回の争点を直接整理する包括的な連邦法は成立しておらず、現状は国防総省の指令3000.09号(自律型兵器に関する指針、2023年改訂)のような省内指針の比重が大きい。これは法律ではなく内部指針であり、政権が変われば変更されうる。軍事技術の詳細は機密性が高く公開審議になじみにくく、AIの能力変化も速いため、立法が難しい事情はある。それでも、企業の利用規約と行政府の要求だけで人命に関わるルールが決まる状態は、やはり脆い。

第二に、そのルールの遵守を監視する独立した監査機関を設けること。しかし、軍事機密を扱える監査機関をどう設計するかという問題がある。機密情報にアクセスできなければ実質的な監査はできないが、アクセスできる機関は独立性を保ちにくい。この矛盾は制度設計の根幹に関わるもので、簡単には解消しない。

第三に、この問題は一国の法律だけでは解決しないから、国際的な条約や協定の枠組みで議論すること。EUはAI Act(AI規制法)の整備を進めているが、AI Actの第2条は、軍事・防衛・国家安全保障の目的に専ら使われるAIシステムを適用除外としている。つまり、まさにこの記事が扱っている領域は、現時点で最も進んだAI規制法の射程からも外れている。国際的な枠組みについても、核兵器のNPTや化学兵器禁止条約のようなモデルが参照されることがあるが、AIの軍民両用性(同じ技術が民間にも軍事にも使える性質)は核や化学兵器とは根本的に異なるため、既存の軍縮条約の枠組みをそのまま適用することはできない。新しい枠組みの構築には、おそらく何年、あるいは何十年もかかる。

つまり、私が「こうすべきだ」と考える方向性は、いずれもすぐには実現しない。この正直さは必要だと思う。「立法で解決すべきだ」と言うだけなら簡単だが、なぜそれが実現していないのかを示さなければ、ただの掛け声に終わる。

それでも私は、方向性としてはこれしかないと考えている。企業の信念は立派だが、3日間の最後通牒に耐えられるかどうかは、その企業のCEOの胆力に依存する。個人の胆力に依存するルールは、ルールとしては脆い。

2026年2月27日に起きたことの意味は、まだ完全には見えていない。しかし、少なくともひとつのことは確信をもって言える。AIが人の生死に関わる判断にどこまで関与してよいかという問いの答えを、ひとつの企業の利用規約に委ねるべきではない。そして、ひとつの政府機関の3日間の最後通牒に委ねるべきでもない。

この問いは、民主的な手続きを通じて、社会全体で決めるべきものだ。そしてその手続きを作ること自体が、今のところ誰にもできていない。2月27日は、その現実を突きつけた日だった。

参考文献

以下は、本記事の執筆にあたって参照した主な情報源である。まず当事者による一次情報を確認し、不足する部分を制度・法令、報道機関の取材・報道で補った。

当事者による一次情報

- Anthropic. “Statement on the comments from Secretary of War Pete Hegseth.” 2026年2月27日.

- Anthropic. “Where things stand with the Department of War.” 2026年3月5日.

- Anthropic. “Anthropic and the Department of Defense to advance responsible AI in defense operations.” 2025年7月14日.

- Anthropic. “Anthropic raises $30 billion in Series G funding at $380 billion post-money valuation.” 2026年2月12日.

- Anthropic. “Claude Gov Models for U.S. National Security Customers.” 2025年6月6日.

- Anthropic Help Center. “Exceptions to our Usage Policy.”

- OpenAI. “Our agreement with the Department of War.” 2026年2月28日(2026年3月2日追記あり).

- OpenAI. “OpenAI and Amazon announce strategic partnership.” 2026年2月27日.

- Microsoft. “Microsoft and OpenAI joint statement on continuing partnership.” 2026年2月27日.

- Apple. “A Message to Our Customers.” 2016年2月16日.

- Apple Support. 「中国本土におけるiCloudについて」.

制度・法令

- EU AI Act Service Desk. “Article 2: Scope.”

- U.S. Department of Defense. “DoD Directive 3000.09.” 2023年1月25日版.

- 10 U.S. Code § 3252. “Requirements for information relating to supply chain risk.”

報道機関による取材・報道

- NPR. “OpenAI announces Pentagon deal after Trump bans Anthropic.” 2026年2月27日〜28日.

- Axios. “Exclusive: Hegseth gives Anthropic until Friday to back down.” 2026年2月24日.

- Axios. “Pentagon used Anthropic’s Claude during Maduro raid.” 2026年2月13日.

- NBC News. “Tensions between the Pentagon and AI giant Anthropic reach a boiling point.” 2026年2月20日.

- Washington Post. “The hypothetical nuclear attack that escalated the Pentagon’s showdown with Anthropic.” 2026年2月27日.

- CBS News. “Anthropic CEO says he’s sticking to AI ‘red lines’ after Pentagon blacklists company.” 2026年2月28日.

- CNBC. “Anthropic faces lose-lose scenario in Pentagon conflict.” 2026年2月27日.

- Bloomberg. “Pentagon Pressures Anthropic to Drop AI Guardrails in Military Standoff.” 2026年2月26日.

- Bloomberg Radio. Gregory Allen(CSIS)によるコメント紹介. 2026年2月27日頃.

- TechCrunch. “OpenAI raises $110B in one of the largest private funding rounds in history.” 2026年2月27日.

コメント